2倍提速!KV缓存压缩不只看重要性,上交大团队让模型推理「又快又稳」 | ICLR'26

2倍提速!KV缓存压缩不只看重要性,上交大团队让模型推理「又快又稳」 | ICLR'26长上下文推理已经成了VLM/LLM的默认形态。

来自主题: AI技术研报

5879 点击 2026-04-01 09:40

搜索

搜索

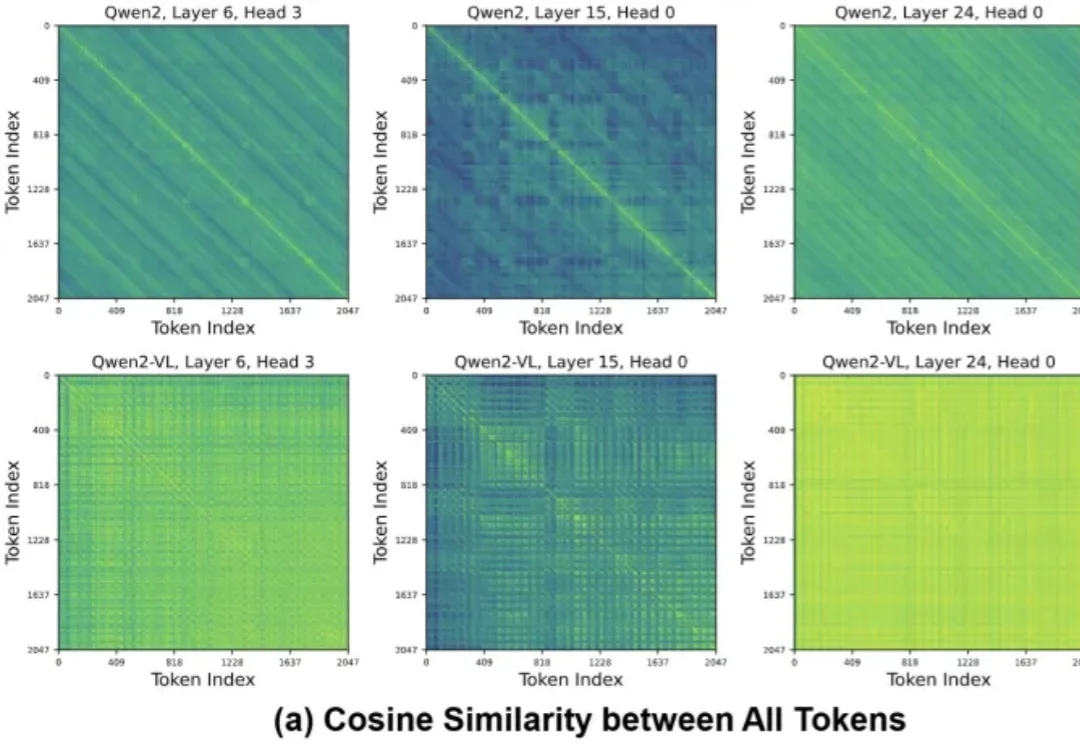

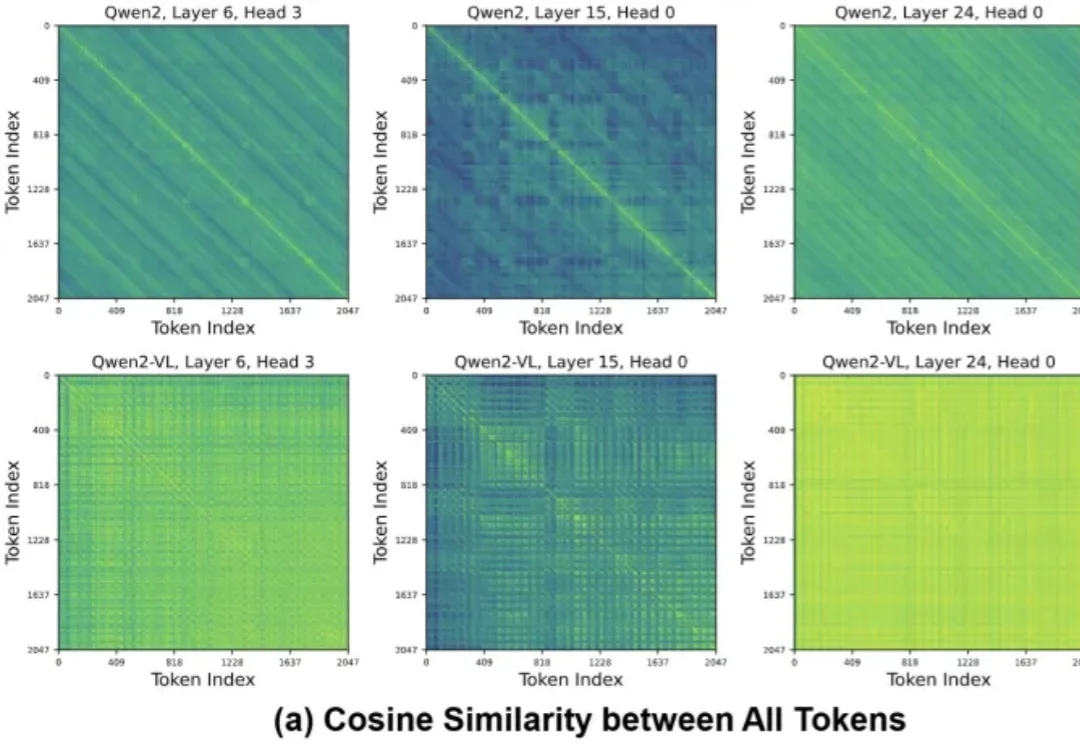

长上下文推理已经成了VLM/LLM的默认形态。

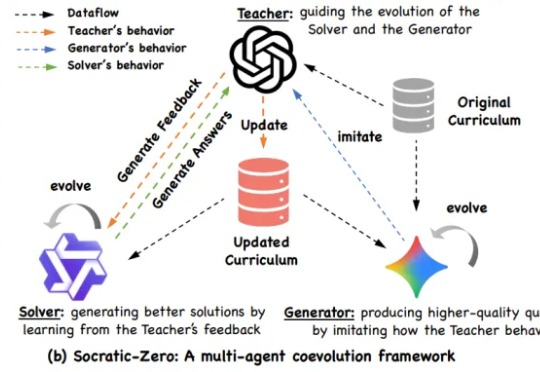

阿里巴巴与上海交通大学 EPIC Lab 联合提出 Socratic-Zero,一个完全无外部数据依赖的自主推理训练框架。该方法仅从 100 个种子问题出发,通过三个智能体的协同进化,自动生成高质量、难度自适应的课程,并持续提升模型推理能力。